10月7日消息,据最新爆料,OpenAI正在探索自研AI芯片,同时开始评估潜在收购目标。其招聘网站上,最近也出现了AI硬件共同开发、评估相关岗位。

摆脱对英伟达的过度依赖,OpenAI是要动真格了。

自ChatGPT掀起最新AI趋势后,算力焦虑笼罩在各大AI厂商头上。无论是模型训练推理,还是API调用都需要算力作为支撑,有多少卡也成为衡量AI厂商实力如何的硬指标之一。

而眼下的GPU市场,英伟达一家独大,市场份额超80%。与此同时,GPU不仅紧俏还贵,自研AI芯片也意味着能大幅降低算力成本。所以,OpenAI自研芯片完全是情理之中。

然而,路透社报道称 OpenAI 尚未决定继续推进这项 AI 芯片开发计划毕竟,研发 AI 芯片是一个昂贵且耗时的过程。OpenAI 花了五年多的时间来研发 GPT-4,AI 芯片等硬件的开发时间也不会短。

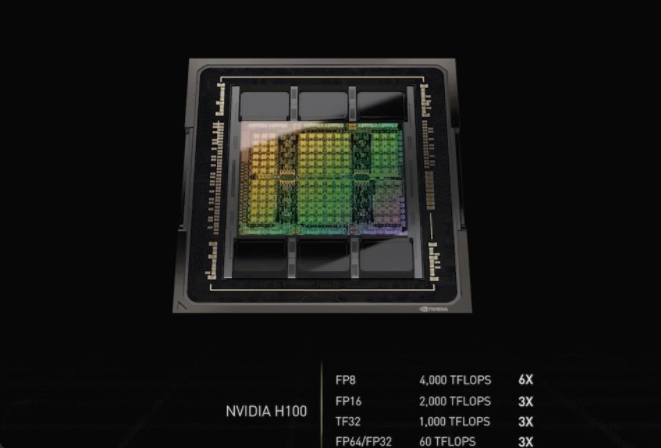

当前,英伟达的 H100 等 AI 芯片是目前科技领域最有价值的资源之一,因为它们对于训练 ChatGPT 等大型语言模型至关重要。这也让科技巨头们纷纷购入大量 AI 芯片,导致芯片短缺问题更加严重,间接提高了大模型的运行成本。

今年早些时候,有分析师估计 ChatGPT 的运行成本高达每天 70 万美元。如果 OpenAI 成功研发自己的 AI 芯片,该公司推出的大模型的运行成本将有望减少。

前特斯拉 AI 总监、重回 OpenAI 的 AI 大牛 Andrej Karpathy 曾预测 GPT-5 可能需要 30000-50000 张 H100。显然,芯片短缺问题限制了 OpenAI 的发展脚步。OpenAI 首席执行官 Sam Altman 更是曾公开抱怨 GPU 市场由英伟达主导。

cr:中国半导体论坛,侵权删除